1. –Т—Б—В—Г–њ: –Ј—А–Њ—Б—В–∞—О—З–Є–є –≤–Є–Ї–ї–Є–Ї –і–µ–Ј—Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—Ч –≤ —Б–Њ—Ж—Ц–∞–ї—М–љ–Є—Е –Љ–µ—А–µ–ґ–∞—Е

–†–Њ–Ј–≤–Є—В–Њ–Ї —И—В—Г—З–љ–Њ–≥–Њ —Ц–љ—В–µ–ї–µ–Ї—В—Г (–®–Ж) –њ—А–Є–љ—Ц—Б –љ–∞–і—Ц—О –љ–∞ –±—Ц–ї—М—И –µ—Д–µ–Ї—В–Є–≤–љ—Г –±–Њ—А–Њ—В—М–±—Г –Ј –і–µ–Ј—Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—Ф—О. –Ч–∞–≤–і—П–Ї–Є –Ј–і–∞—В–љ–Њ—Б—В—Ц –∞–љ–∞–ї—Ц–Ј—Г–≤–∞—В–Є –≤–µ–ї–Є—З–µ–Ј–љ—Ц –Љ–∞—Б–Є–≤–Є –і–∞–љ–Є—Е, –≤–Є—П–≤–ї—П—В–Є –Ј–∞–Ї–Њ–љ–Њ–Љ—Ц—А–љ–Њ—Б—В—Ц —В–∞ –њ–µ—А–µ—Е—А–µ—Б–љ—Ц –њ–Њ—Б–Є–ї–∞–љ–љ—П –љ–∞ —Д–∞–Ї—В–Є –≤ –Љ–∞—Б—И—В–∞–±—Ц, –®–Ж –Ј–Љ—Ц–љ—О—Ф –љ–∞—И –њ—Ц–і—Е—Ц–і –і–Њ –њ–µ—А–µ–≤—Ц—А–Ї–Є —Д–∞–Ї—В—Ц–≤ —Г —Б–Њ—Ж—Ц–∞–ї—М–љ–Є—Е –Љ–µ—А–µ–ґ–∞—Е. –£ —Ж—М–Њ–Љ—Г –±–ї–Њ–Ј—Ц –Љ–Є –і–Њ—Б–ї—Ц–і–Є–Љ–Њ, —П–Ї AI –≤–Є–Ї–Њ—А–Є—Б—В–Њ–≤—Г—Ф—В—М—Б—П –і–ї—П –±–Њ—А–Њ—В—М–±–Є –Ј –і–µ–Ј—Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—Ф—О, –њ—А–Њ–±–ї–µ–Љ–Є, –Ј —П–Ї–Є–Љ–Є –≤—Ц–љ —Б—В–Є–Ї–∞—Ф—В—М—Б—П, —Ц –Љ–∞–є–±—Г—В–љ—Ф –њ–µ—А–µ–≤—Ц—А–Ї–Є —Д–∞–Ї—В—Ц–≤ –≤ –µ–њ–Њ—Е—Г –∞–≤—В–Њ–Љ–∞—В–Є–Ј–∞—Ж—Ц—Ч.

2. –†–Њ–Ј—Г–Љ—Ц–љ–љ—П –і–µ–Ј—Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—Ч —В–∞ —Ч—Ч –≤–њ–ї–Є–≤—Г

–Я–Њ–ї—Ц—В–Є—З–љ–Є–є –≤–њ–ї–Є–≤: –љ–µ–њ—А–∞–≤–і–Є–≤–∞ —Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—П –Љ–Њ–ґ–µ –≤–њ–ї–Є–љ—Г—В–Є –љ–∞ –≤–Є–±–Њ—А—Ж—Ц–≤, —Б–њ–Њ—В–≤–Њ—А–Є—В–Є –њ–Њ–ї—Ц—В–Є—З–љ—Ц –і–µ–±–∞—В–Є —В–∞ –љ–∞–≤—Ц—В—М –≤–њ–ї–Є–љ—Г—В–Є –љ–∞ –≤–Є–±–Њ—А–Є. –Ф–µ–Ј—Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—П –њ—А–Њ –Ї–∞–љ–і–Є–і–∞—В—Ц–≤, –њ–Њ–ї—Ц—В–Є–Ї—Г —З–Є –њ—А–Њ—Ж–µ–і—Г—А–Є –≥–Њ–ї–Њ—Б—Г–≤–∞–љ–љ—П –Љ–Њ–ґ–µ –њ—А–Є–Ј–≤–µ—Б—В–Є –і–Њ –≤—Ц–і—Б—Г—В–љ–Њ—Б—В—Ц –і–Њ–≤—Ц—А–Є –і–Њ –і–µ–Љ–Њ–Ї—А–∞—В–Є—З–љ–Є—Е –њ—А–Њ—Ж–µ—Б—Ц–≤.

–†–Є–Ј–Є–Ї–Є –і–ї—П –Ј–і–Њ—А–Њ–≤вАЩ—П —В–∞ –±–µ–Ј–њ–µ–Ї–Є. –Ф–µ–Ј—Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—П –њ—А–Њ –Ј–і–Њ—А–Њ–≤вАЩ—П, –Њ—Б–Њ–±–ї–Є–≤–Њ –њ—Ц–і —З–∞—Б —В–∞–Ї–Є—Е –њ–Њ–і—Ц–є, —П–Ї –њ–∞–љ–і–µ–Љ—Ц—П COVID-19, –Љ–Њ–ґ–µ –Љ–∞—В–Є –љ–µ–±–µ–Ј–њ–µ—З–љ—Ц –і–ї—П –ґ–Є—В—В—П –љ–∞—Б–ї—Ц–і–Ї–Є. –Э–µ–њ—А–∞–≤–і–Є–≤—Ц –Ј–∞—П–≤–Є –њ—А–Њ –ї—Ц–Ї—Г–≤–∞–љ–љ—П –∞–±–Њ –≤–∞–Ї—Ж–Є–љ–Є –Љ–Њ–ґ—Г—В—М –њ—А–Є–Ј–≤–µ—Б—В–Є –і–Њ –Љ–∞—Б–Њ–≤–Њ—Ч –њ–ї—Г—В–∞–љ–Є–љ–Є —В–∞ –љ–µ–±–µ–Ј–њ–µ—З–љ–Њ—Ч –њ–Њ–≤–µ–і—Ц–љ–Ї–Є.

–Я—Ц–і—А–Є–≤ –і–Њ–≤—Ц—А–Є: –Я–Њ—Б—В—Ц–є–љ–Є–є –і–Њ—Б—В—Г–њ –і–Њ –Њ–Љ–∞–љ–ї–Є–≤–Њ—Ч –∞–±–Њ –љ–µ–њ—А–∞–≤–і–Є–≤–Њ—Ч —Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—Ч –Љ–Њ–ґ–µ –њ—Ц–і—Ц—А–≤–∞—В–Є –і–Њ–≤—Ц—А—Г –і–Њ –њ–ї–∞—В—Д–Њ—А–Љ —Б–Њ—Ж—Ц–∞–ї—М–љ–Є—Е –Љ–µ–і—Ц–∞, —Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц–є–љ–Є—Е –∞–≥–µ–љ—В—Б—В–≤ —Ц –љ–∞–≤—Ц—В—М —Г—А—П–і—Ц–≤, —Й–Њ –њ—А–Є–Ј–≤–µ–і–µ –і–Њ —А–Њ–Ј–±—Ц–ґ–љ–Њ—Б—В–µ–є —Г —Б—Г—Б–њ—Ц–ї—М—Б—В–≤—Ц —В–∞ —Б–Ї–µ–њ—Б–Є—Б—Г.

3. –ѓ–Ї –®–Ж –і–Њ–њ–Њ–Љ–∞–≥–∞—Ф –±–Њ—А–Њ—В–Є—Б—П –Ј –і–µ–Ј—Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—Ф—О

–Р–≤—В–Њ–Љ–∞—В–Є–Ј–Њ–≤–∞–љ–∞ –њ–µ—А–µ–≤—Ц—А–Ї–∞ —Д–∞–Ї—В—Ц–≤: —И—В—Г—З–љ–Є–є —Ц–љ—В–µ–ї–µ–Ї—В –Љ–Њ–ґ–µ –∞–≤—В–Њ–Љ–∞—В–Є–Ј—Г–≤–∞—В–Є –њ—А–Њ—Ж–µ—Б –њ–µ—А–µ–≤—Ц—А–Ї–Є —Д–∞–Ї—В—Ц–≤, –њ–Њ—А—Ц–≤–љ—О—О—З–Є –≤–Љ—Ц—Б—В —Б–Њ—Ж—Ц–∞–ї—М–љ–Є—Е –Љ–µ—А–µ–ґ —Ц–Ј –љ–∞–і—Ц–є–љ–Є–Љ–Є –±–∞–Ј–∞–Љ–Є –і–∞–љ–Є—Е —Ц –і–ґ–µ—А–µ–ї–∞–Љ–Є –њ—А–∞–≤–і–Є. –Р–ї–≥–Њ—А–Є—В–Љ–Є —И—В—Г—З–љ–Њ–≥–Њ —Ц–љ—В–µ–ї–µ–Ї—В—Г –љ–∞–≤—З–µ–љ—Ц –≤–Є—П–≤–ї—П—В–Є –љ–µ–≤—Ц–і–њ–Њ–≤—Ц–і–љ–Њ—Б—В—Ц, –њ–µ—А–µ–≤—Ц—А—П—В–Є —В–Њ—З–љ—Ц—Б—В—М —В–≤–µ—А–і–ґ–µ–љ—М —Ц –њ–Њ–Ј–љ–∞—З–∞—В–Є –≤–Љ—Ц—Б—В, —П–Ї–Є–є –њ–Њ—В—А–µ–±—Г—Ф –њ–Њ–і–∞–ї—М—И–Њ—Ч –њ–µ—А–µ–≤—Ц—А–Ї–Є.

–Ъ–Њ–љ—В–µ–Ї—Б—В–љ–Є–є –∞–љ–∞–ї—Ц–Ј. –Ч–і–∞—В–љ—Ц—Б—В—М —И—В—Г—З–љ–Њ–≥–Њ —Ц–љ—В–µ–ї–µ–Ї—В—Г –∞–љ–∞–ї—Ц–Ј—Г–≤–∞—В–Є –љ–µ –ї–Є—И–µ —Б–ї–Њ–≤–∞, –∞ –є –Ї–Њ–љ—В–µ–Ї—Б—В, —Г —П–Ї–Њ–Љ—Г –≤–Њ–љ–Є –≤–ґ–Є–≤–∞—О—В—М—Б—П, –Љ–∞—Ф –≤–Є—А—Ц—И–∞–ї—М–љ–µ –Ј–љ–∞—З–µ–љ–љ—П –і–ї—П –≤–Є—П–≤–ї–µ–љ–љ—П –і–µ–Ј—Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—Ч. –Э–∞–њ—А–Є–Ї–ї–∞–і, —И—В—Г—З–љ–Є–є —Ц–љ—В–µ–ї–µ–Ї—В –Љ–Њ–ґ–µ —А–Њ–Ј–њ—Ц–Ј–љ–∞–≤–∞—В–Є –Њ–Љ–∞–љ–ї–Є–≤—Ц –Ј–∞–≥–Њ–ї–Њ–≤–Ї–Є, –Ї–ї—Ц–Ї–±–µ–є—В –∞–±–Њ —Б–µ–љ—Б–∞—Ж—Ц–є–љ—Ц –љ–∞—А–∞—В–Є–≤–Є, —П–Ї—Ц —З–∞—Б—В–Њ –≤–Є–Ї–Њ—А–Є—Б—В–Њ–≤—Г—О—В—М—Б—П –і–ї—П –њ–Њ—И–Є—А–µ–љ–љ—П –љ–µ–њ—А–∞–≤–і–Є–≤–Њ—Ч —Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—Ч.

–Ь–Њ–љ—Ц—В–Њ—А–Є–љ–≥ —Г —А–µ–ґ–Є–Љ—Ц —А–µ–∞–ї—М–љ–Њ–≥–Њ —З–∞—Б—Г. –Ж–љ—Б—В—А—Г–Љ–µ–љ—В–Є —И—В—Г—З–љ–Њ–≥–Њ —Ц–љ—В–µ–ї–µ–Ї—В—Г –Љ–Њ–ґ—Г—В—М –Ї–Њ–љ—В—А–Њ–ї—О–≤–∞—В–Є –Ї–∞–љ–∞–ї–Є —Б–Њ—Ж—Ц–∞–ї—М–љ–Є—Е –Љ–µ—А–µ–ґ —Ц –њ–Њ–Ј–љ–∞—З–∞—В–Є –њ—Ц–і–Њ–Ј—А—Ц–ї–Є–є –∞–±–Њ —И–Ї—Ц–і–ї–Є–≤–Є–є –≤–Љ—Ц—Б—В, –Ї–Њ–ї–Є –≤—Ц–љ –ЈвАЩ—П–≤–ї—П—Ф—В—М—Б—П. –¶–µ –і–Њ–Ј–≤–Њ–ї—П—Ф —И–≤–Є–і—И–µ —А–µ–∞–≥—Г–≤–∞—В–Є –љ–∞ –њ–Њ—П–≤—Г –і–µ–Ј—Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—Ч, —Б–Ї–Њ—А–Њ—З—Г—О—З–Є —З–∞—Б, –љ–µ–Њ–±—Е—Ц–і–љ–Є–є –і–ї—П —Ч—Ч –њ–Њ—И–Є—А–µ–љ–љ—П.

–Я–µ—А–µ–≤—Ц—А–Ї–∞ –Ј–Њ–±—А–∞–ґ–µ–љ—М —Ц –≤—Ц–і–µ–Њ: —И—В—Г—З–љ–Є–є —Ц–љ—В–µ–ї–µ–Ї—В —В–∞–Ї–Њ–ґ –≤–Љ—Ц—Ф –∞–љ–∞–ї—Ц–Ј—Г–≤–∞—В–Є –Ј–Њ–±—А–∞–ґ–µ–љ–љ—П —В–∞ –≤—Ц–і–µ–Њ –љ–∞ –Њ–Ј–љ–∞–Ї–Є –Љ–∞–љ—Ц–њ—Г–ї—П—Ж—Ц–є –∞–±–Њ —Д–∞–±—А–Є–Ї–∞—Ж—Ц—Ч. –Ж–љ—Б—В—А—Г–Љ–µ–љ—В–Є —И—В—Г—З–љ–Њ–≥–Њ —Ц–љ—В–µ–ї–µ–Ї—В—Г –Љ–Њ–ґ—Г—В—М –≤–Є—П–≤–ї—П—В–Є –Ј–Љ—Ц–љ–µ–љ—Ц –Ј–Њ–±—А–∞–ґ–µ–љ–љ—П, –і–Є–њ—Д–µ–є–Ї–Є —В–∞ –њ—Ц–і—А–Њ–±–ї–µ–љ—Ц –≤—Ц–і–µ–Њ, –Ј–∞–±–µ–Ј–њ–µ—З—Г—О—З–Є —А—Ц–≤–µ–љ—М –Ј–∞—Е–Є—Б—В—Г –≤—Ц–і –≤—Ц–Ј—Г–∞–ї—М–љ–Њ—Ч –і–µ–Ј—Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—Ч.

4. –†–Њ–ї—М —И—В—Г—З–љ–Њ–≥–Њ —Ц–љ—В–µ–ї–µ–Ї—В—Г –≤ –њ–Њ–Ї—А–∞—Й–µ–љ–љ—Ц –њ–Њ–ї—Ц—В–Є–Ї–Є –і–µ–Ј—Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—Ч –њ–ї–∞—В—Д–Њ—А–Љ —Б–Њ—Ж—Ц–∞–ї—М–љ–Є—Е –Љ–µ—А–µ–ґ

–Т–Є—П–≤–ї–µ–љ–љ—Ц —В–∞ –Ј–≤—Ц—В–љ–Њ—Б—В—Ц: –®–Ж –Љ–Њ–ґ–µ —Б–Ї–∞–љ—Г–≤–∞—В–Є –Ї–Њ–љ—В–µ–љ—В –љ–∞ –љ–∞—П–≤–љ—Ц—Б—В—М –љ–µ–њ—А–∞–≤–і–Є–≤–Є—Е —В–≤–µ—А–і–ґ–µ–љ—М —В–∞ –љ–µ–≥–∞–є–љ–Њ –њ–Њ–≤—Ц–і–Њ–Љ–ї—П—В–Є –Љ–Њ–і–µ—А–∞—В–Њ—А—Ц–≤ –њ–ї–∞—В—Д–Њ—А–Љ–Є. –¶—П —Б–Є—Б—В–µ–Љ–∞ –Љ–Њ–ґ–µ –≤–Є—П–≤–ї—П—В–Є –њ—А–Њ–±–ї–µ–Љ–љ–Є–є –Ї–Њ–љ—В–µ–љ—В –љ–∞–±–∞–≥–∞—В–Њ —И–≤–Є–і—И–µ, –љ—Ц–ґ –Љ–Њ–і–µ—А–∞—В–Њ—А–Є-–ї—О–і–Є, —П–Ї—Ц —З–∞—Б—В–Њ –њ–µ—А–µ–≤–∞–љ—В–∞–ґ–µ–љ—Ц –≤–µ–ї–Є—З–µ–Ј–љ–Њ—О –Ї—Ц–ї—М–Ї—Ц—Б—В—О –њ—Г–±–ї—Ц–Ї–∞—Ж—Ц–є.

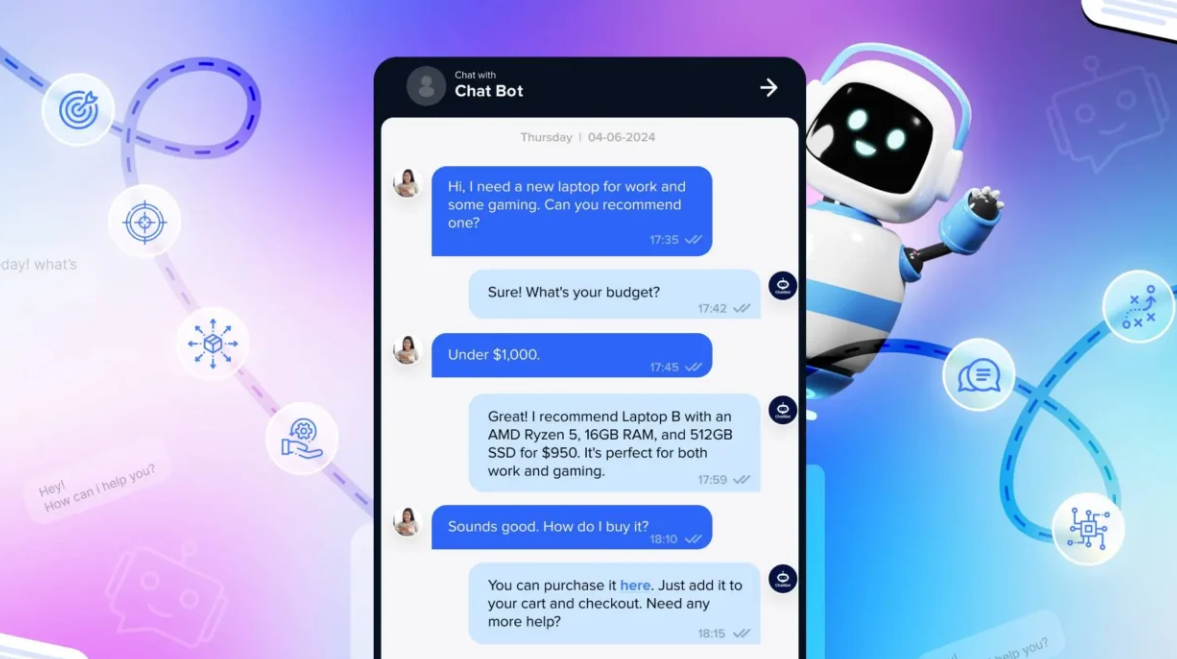

–Э–∞–≤—З–∞–љ–љ—Ц –Ї–Њ—А–Є—Б—В—Г–≤–∞—З—Ц–≤: –Ф–µ—П–Ї—Ц –њ–ї–∞—В—Д–Њ—А–Љ–Є —Б–Њ—Ж—Ц–∞–ї—М–љ–Є—Е –Љ–µ—А–µ–ґ –њ–Њ—З–∞–ї–Є –≤–Є–Ї–Њ—А–Є—Б—В–Њ–≤—Г–≤–∞—В–Є –®–Ж, —Й–Њ–± –љ–∞–і–∞–≤–∞—В–Є –Ї–Њ—А–Є—Б—В—Г–≤–∞—З–∞–Љ –Њ—Б–≤—Ц—В–љ—Ц —Б–њ–ї–Є–≤–∞—О—З—Ц –≤—Ц–Ї–љ–∞ –∞–±–Њ –∞–ї—М—В–µ—А–љ–∞—В–Є–≤–љ—Ц —В–Њ—З–Ї–Є –Ј–Њ—А—Г, –Ї–Њ–ї–Є –≤–Њ–љ–Є —Б—В–Є–Ї–∞—О—В—М—Б—П –Ј –њ–Њ—В–µ–љ—Ж—Ц–є–љ–Њ –Њ–Љ–∞–љ–ї–Є–≤–Њ—О —Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—Ф—О. –¶–µ –і–Њ–њ–Њ–Љ–∞–≥–∞—Ф –Ј–Љ–µ–љ—И–Є—В–Є –њ–Њ—И–Є—А–µ–љ–љ—П –љ–µ–њ—А–∞–≤–і–Є–≤–Њ–≥–Њ –Ї–Њ–љ—В–µ–љ—В—Г, —Б–њ–Њ–љ—Г–Ї–∞—О—З–Є –Ї–Њ—А–Є—Б—В—Г–≤–∞—З—Ц–≤ –њ–µ—А–µ–≥–ї—П–љ—Г—В–Є —Б–≤–Њ—О –і—Г–Љ–Ї—Г –њ–µ—А–µ–і —В–Є–Љ, —П–Ї –і—Ц–ї–Є—В–Є—Б—П –љ–Є–Љ.

–Я—А–Њ–Ј–Њ—А—Ц—Б—В—М —В–∞ –њ—Ц–і–Ј–≤—Ц—В–љ—Ц—Б—В—М: –Ж–љ—Б—В—А—Г–Љ–µ–љ—В–Є –®–Ж —В–∞–Ї–Њ–ґ –Љ–Њ–ґ—Г—В—М –≤—Ц–і—Б—В–µ–ґ—Г–≤–∞—В–Є –њ–Њ—Е–Њ–і–ґ–µ–љ–љ—П –і–µ–Ј—Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—Ч, –і–Њ–њ–Њ–Љ–∞–≥–∞—О—З–Є –њ–ї–∞—В—Д–Њ—А–Љ–∞–Љ –Ї—А–∞—Й–µ –Ј—А–Њ–Ј—Г–Љ—Ц—В–Є, —П–Ї —Ц –Ј–≤—Ц–і–Ї–Є –њ–Њ—Е–Њ–і–Є—В—М –Њ–Љ–∞–љ–ї–Є–≤–Є–є –Ї–Њ–љ—В–µ–љ—В. –¶—П —Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—П —Ф –≤–∞–ґ–ї–Є–≤–Њ—О –і–ї—П –њ—Ц–і–≤–Є—Й–µ–љ–љ—П –њ—Ц–і–Ј–≤—Ц—В–љ–Њ—Б—В—Ц —В–∞ –Ј–∞–њ–Њ–±—Ц–≥–∞–љ–љ—П –њ–Њ–і–∞–ї—М—И–Њ–Љ—Г –њ–Њ—И–Є—А–µ–љ–љ—О –љ–µ–њ—А–∞–≤–і–Є–≤–Њ—Ч —Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—Ч.

–Э–∞–ї–∞—И—В–Њ–≤—Г–≤–∞–љ—Ц —Д—Ц–ї—М—В—А–Є –і–µ–Ј—Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—Ч: –®–Ж –Љ–Њ–ґ–љ–∞ –≤–Є–Ї–Њ—А–Є—Б—В–Њ–≤—Г–≤–∞—В–Є –і–ї—П —Б—В–≤–Њ—А–µ–љ–љ—П –љ–∞–ї–∞—И—В–Њ–≤–∞–љ–Є—Е —Д—Ц–ї—М—В—А—Ц–≤ –і–µ–Ј—Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—Ч –љ–∞ –Њ—Б–љ–Њ–≤—Ц —Г–њ–Њ–і–Њ–±–∞–љ—М –Ї–Њ—А–Є—Б—В—Г–≤–∞—З–∞ —В–∞ –Ј–≤–Є—З–Њ–Ї –њ–µ—А–µ–≥–ї—П–і—Г. –¶–µ –і–Њ–Ј–≤–Њ–ї—П—Ф –њ–ї–∞—В—Д–Њ—А–Љ–∞–Љ —Б–Њ—Ж—Ц–∞–ї—М–љ–Є—Е –Љ–µ—А–µ–ґ –∞–і–∞–њ—В—Г–≤–∞—В–Є –Љ–Њ–љ—Ц—В–Њ—А–Є–љ–≥ –і–µ–Ј—Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—Ч –і–Њ –њ–µ–≤–љ–Є—Е —Б–њ—Ц–ї—М–љ–Њ—В –∞–±–Њ –≥—А—Г–њ –Ї–Њ—А–Є—Б—В—Г–≤–∞—З—Ц–≤.

5. –Т–Є–Ї–ї–Є–Ї–Є –®–Ж —Г –±–Њ—А–Њ—В—М–±—Ц –Ј –і–µ–Ј—Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—Ф—О

–£–њ–µ—А–µ–і–ґ–µ–љ—Ц—Б—В—М –≤ –∞–ї–≥–Њ—А–Є—В–Љ–∞—Е –®–Ж: –Р–ї–≥–Њ—А–Є—В–Љ–Є –®–Ж –љ–∞—Б—В—Ц–ї—М–Ї–Є –ґ —Е–Њ—А–Њ—И—Ц, –љ–∞—Б–Ї—Ц–ї—М–Ї–Є —Е–Њ—А–Њ—И—Ц –і–∞–љ—Ц, –љ–∞ —П–Ї–Є—Е –≤–Њ–љ–Є –љ–∞–≤—З–∞—О—В—М—Б—П. –ѓ–Ї—Й–Њ —Б–Є—Б—В–µ–Љ–∞ –®–Ж –љ–∞–≤—З–∞—Ф—В—М—Б—П –љ–∞ —Г–њ–µ—А–µ–і–ґ–µ–љ–Є—Е –∞–±–Њ –љ–µ–њ–Њ–≤–љ–Є—Е –і–∞–љ–Є—Е, —Ч–є –Љ–Њ–ґ–µ –±—Г—В–Є –≤–∞–ґ–Ї–Њ —В–Њ—З–љ–Њ —Ц–і–µ–љ—В–Є—Д—Ц–Ї—Г–≤–∞—В–Є –і–µ–Ј—Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—О. –¶–µ –Љ–Њ–ґ–µ –њ—А–Є–Ј–≤–µ—Б—В–Є –і–Њ —В–Њ–≥–Њ, —Й–Њ –њ–µ–≤–љ—Ц –љ–µ–њ—А–∞–≤–і–Є–≤—Ц —В–≤–µ—А–і–ґ–µ–љ–љ—П –±—Г–і—Г—В—М –њ—А–Њ–њ—Г—Й–µ–љ—Ц –∞–±–Њ, –љ–∞–≤–њ–∞–Ї–Є, –ї–µ–≥—Ц—В–Є–Љ–љ–Є–є –Ї–Њ–љ—В–µ–љ—В –±—Г–і–µ –њ–Њ–Љ–Є–ї–Ї–Њ–≤–Њ –њ–Њ–Ј–љ–∞—З–µ–љ–Є–є —П–Ї —Е–Є–±–љ–Є–є.

–Т–Є—В–Њ–љ—З–µ–љ–∞ —В–∞–Ї—В–Є–Ї–∞ –і–µ–Ј—Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—Ч: –Ґ–≤–Њ—А—Ж—Ц –і–µ–Ј—Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—Ч –њ–Њ—Б—В—Ц–є–љ–Њ –≤–і–Њ—Б–Ї–Њ–љ–∞–ї—О—О—В—М —Б–≤–Њ—Ч —Б—В—А–∞—В–µ–≥—Ц—Ч, —Й–Њ–± —Г–љ–Є–Ї–љ—Г—В–Є –≤–Є—П–≤–ї–µ–љ–љ—П. –®–Ж –Љ–Њ–ґ–µ –±—Г—В–Є –≤–∞–ґ–Ї–Њ —А–Њ–Ј–њ—Ц–Ј–љ–∞—В–Є —В–∞–Ї—Ц –Љ–µ—В–Њ–і–Є, —П–Ї –≤–Є–Ї–Њ—А–Є—Б—В–∞–љ–љ—П –Ј–∞–Ї–Њ–і–Њ–≤–∞–љ–Њ—Ч –Љ–Њ–≤–Є, –Љ–µ–Љ—Ц–≤ —В–∞ —В–Њ–љ–Ї–Њ—Ч –і–µ–Ј—Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—Ч.

–Ъ–Њ–љ—В–µ–Ї—Б—В —В–∞ –љ—О–∞–љ—Б–Є: –®–Ж –Љ–Њ–ґ–µ –Љ–∞—В–Є —В—А—Г–і–љ–Њ—Й—Ц –Ј —А–Њ–Ј—Г–Љ—Ц–љ–љ—П–Љ –њ–Њ–≤–љ–Њ–≥–Њ –Ї–Њ–љ—В–µ–Ї—Б—В—Г –њ–µ–≤–љ–Њ–≥–Њ –Ї–Њ–љ—В–µ–љ—В—Г, –Њ—Б–Њ–±–ї–Є–≤–Њ –≤ –і—Г–ґ–µ –љ—О–∞–љ—Б–Њ–≤–∞–љ–Є—Е —Б–Є—В—Г–∞—Ж—Ц—П—Е. –У—Г–Љ–Њ—А, —Б–∞—В–Є—А–∞ –∞–±–Њ —Б–Ї–ї–∞–і–љ–Є–є –њ–Њ–ї—Ц—В–Є—З–љ–Є–є –і–Є—Б–Ї—Г—А—Б –Љ–Њ–ґ—Г—В—М –±—Г—В–Є –≤–∞–ґ–Ї–Є–Љ–Є –і–ї—П —В–Њ—З–љ–Њ—Ч –Њ–±—А–Њ–±–Ї–Є –®–Ж, —Й–Њ –њ—А–Є–Ј–≤–Њ–і–Є—В—М –і–Њ —Е–Є–±–љ–Њ–њ–Њ–Ј–Є—В–Є–≤–љ–Є—Е —А–µ–Ј—Г–ї—М—В–∞—В—Ц–≤ –∞–±–Њ –њ—А–Њ–њ—Г—Й–µ–љ–Є—Е –љ–µ–њ—А–∞–≤–і–Є–≤–Є—Е —Д–∞–Ї—В—Ц–≤.

–Э–∞–і–Љ—Ц—А–љ–∞ –Ј–∞–ї–µ–ґ–љ—Ц—Б—В—М –≤—Ц–і –®–Ж: –•–Њ—З–∞ –®–Ж —Ф –њ–Њ—В—Г–ґ–љ–Є–Љ —Ц–љ—Б—В—А—Г–Љ–µ–љ—В–Њ–Љ, –≤–∞–ґ–ї–Є–≤–Њ –њ–∞–Љ'—П—В–∞—В–Є, —Й–Њ –≤—Ц–љ –љ–µ –Љ–Њ–ґ–µ –њ–Њ–≤–љ—Ц—Б—В—О –Ј–∞–Љ—Ц–љ–Є—В–Є –ї—О–і—Б—М–Ї–µ —Б—Г–і–ґ–µ–љ–љ—П. –°–Ї–ї–∞–і–љ—Ц—Б—В—М –ї—О–і—Б—М–Ї–Њ—Ч –Љ–Њ–≤–Є —В–∞ –µ–≤–Њ–ї—О—Ж—Ц–є–љ–Є–є —Е–∞—А–∞–Ї—В–µ—А –і–µ–Ј—Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—Ч –≤–Є–Љ–∞–≥–∞—О—В—М –Ј–±–∞–ї–∞–љ—Б–Њ–≤–∞–љ–Њ–≥–Њ –њ—Ц–і—Е–Њ–і—Г, —П–Ї–Є–є –≤—А–∞—Е–Њ–≤—Г—Ф –ї—О–і—Б—М–Ї–Є–є –љ–∞–≥–ї—П–і —А–∞–Ј–Њ–Љ –Ј—Ц —И—В—Г—З–љ–Є–Љ —Ц–љ—В–µ–ї–µ–Ї—В–Њ–Љ.

–Я—А–Њ—В–µ—Б—В—Г–є—В–µ –®–Ж –љ–∞ –Т–Р–®–Ю–Ь–£ –≤–µ–±-—Б–∞–є—В—Ц –Ј–∞ 60 —Б–µ–Ї—Г–љ–і

–Я–Њ–і–Є–≤—Ц—В—М—Б—П, —П–Ї –љ–∞—И —И—В—Г—З–љ–Є–є —Ц–љ—В–µ–ї–µ–Ї—В –Љ–Є—В—В—Ф–≤–Њ –∞–љ–∞–ї—Ц–Ј—Г—Ф –≤–∞—И –≤–µ–±-—Б–∞–є—В —Ц —Б—В–≤–Њ—А—О—Ф –њ–µ—А—Б–Њ–љ–∞–ї—Ц–Ј–Њ–≤–∞–љ–Њ–≥–Њ —З–∞—В-–±–Њ—В–∞ - –±–µ–Ј —А–µ—Ф—Б—В—А–∞—Ж—Ц—Ч. –Я—А–Њ—Б—В–Њ –≤–≤–µ–і—Ц—В—М —Б–≤–Њ—О URL-–∞–і—А–µ—Б—Г —В–∞ —Б–њ–Њ—Б—В–µ—А—Ц–≥–∞–є—В–µ, —П–Ї —Ж–µ –њ—А–∞—Ж—О—Ф!

6. –®–Ж —В–∞ —Б–њ—Ц–≤–њ—А–∞—Ж—П –ї—О–і–µ–є: —Ц–і–µ–∞–ї—М–љ–Є–є –њ—Ц–і—Е—Ц–і

–®–Ж —П–Ї –њ–µ—А—И–∞ –ї—Ц–љ—Ц—П –Ј–∞—Е–Є—Б—В—Г: –®–Ж –Љ–Њ–ґ–љ–∞ –≤–Є–Ї–Њ—А–Є—Б—В–Њ–≤—Г–≤–∞—В–Є —П–Ї –њ–Њ—З–∞—В–Ї–Њ–≤–Є–є —Д—Ц–ї—М—В—А, —Б–Ї–∞–љ—Г—О—З–Є –≤–Љ—Ц—Б—В –љ–∞ –љ–∞—П–≤–љ—Ц—Б—В—М –њ–Њ—В–µ–љ—Ж—Ц–є–љ–Њ—Ч –і–µ–Ј—Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—Ч —В–∞ –њ–Њ–Ј–љ–∞—З–∞—О—З–Є –є–Њ–≥–Њ –і–ї—П –њ–µ—А–µ–≤—Ц—А–Ї–Є –ї—О–і–Є–љ–Њ—О. –¶–µ –Ј–љ–∞—З–љ–Њ –Ј–Љ–µ–љ—И—Г—Ф –љ–∞–≤–∞–љ—В–∞–ґ–µ–љ–љ—П –љ–∞ –ї—О–і–µ–є-–Љ–Њ–і–µ—А–∞—В–Њ—А—Ц–≤ —Ц –і–Њ–Ј–≤–Њ–ї—П—Ф —Ч–Љ –Ј–Њ—Б–µ—А–µ–і–Є—В–Є—Б—П –љ–∞ –±—Ц–ї—М—И —Б–Ї–ї–∞–і–љ–Є—Е —Б–њ—А–∞–≤–∞—Е.

–Х–Ї—Б–њ–µ—А—В–Є –Ј –њ–µ—А–µ–≤—Ц—А–Ї–Є —Д–∞–Ї—В—Ц–≤: —Б–њ–µ—Ж—Ц–∞–ї—Ц—Б—В–Є –Ј –њ–µ—А–µ–≤—Ц—А–Ї–Є —Д–∞–Ї—В—Ц–≤, –Њ—Б–Њ–±–ї–Є–≤–Њ —В—Ц, —Й–Њ –Љ–∞—О—В—М –і–Њ—Б–≤—Ц–і —Г –њ–µ–≤–љ–Є—Е –≥–∞–ї—Г–Ј—П—Е, –Љ–Њ–ґ—Г—В—М –≤—В—А—Г—В–Є—В–Є—Б—П, —Й–Њ–± –Њ—Ж—Ц–љ–Є—В–Є —В–∞ –љ–∞–і–∞—В–Є –±—Ц–ї—М—И–µ –Ї–Њ–љ—В–µ–Ї—Б—В—Г, –Ї–Њ–ї–Є –®–Ж –≤–Є—П–≤–ї—П—Ф –њ–Њ—В–µ–љ—Ж—Ц–є–љ—Г –і–µ–Ј—Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—О. –¶—П –Ї–Њ–Љ–±—Ц–љ–∞—Ж—Ц—П –≥–∞—А–∞–љ—В—Г—Ф, —Й–Њ —Б–Ї–ї–∞–і–љ—Ц —В–∞ –љ—О–∞–љ—Б–Њ–≤–∞–љ—Ц —Б–њ—А–∞–≤–Є —А–Њ–Ј–≥–ї—П–і–∞—В–Є–Љ—Г—В—М—Б—П –Ј —Г–≤–∞–ґ–љ—Ц—Б—В—О —В–∞ —В–Њ—З–љ—Ц—Б—В—О.

–Э–∞–≤—З–∞–љ–љ—П –Љ–Њ–і–µ–ї–µ–є —И—В—Г—З–љ–Њ–≥–Њ —Ц–љ—В–µ–ї–µ–Ї—В—Г –Ј–∞ –і–Њ–њ–Њ–Љ–Њ–≥–Њ—О —А—Ц–Ј–љ–Њ–Љ–∞–љ—Ц—В–љ–Є—Е –і–∞–љ–Є—Е. –Ы—О–і—Б—М–Ї–Є–є –≤–љ–µ—Б–Њ–Ї –Љ–∞—Ф –≤–Є—А—Ц—И–∞–ї—М–љ–µ –Ј–љ–∞—З–µ–љ–љ—П –і–ї—П –≤–і–Њ—Б–Ї–Њ–љ–∞–ї–µ–љ–љ—П –Љ–Њ–і–µ–ї–µ–є —И—В—Г—З–љ–Њ–≥–Њ —Ц–љ—В–µ–ї–µ–Ї—В—Г. –Я–Њ—Б—В—Ц–є–љ–Њ –Њ–љ–Њ–≤–ї—О—О—З–Є —В–∞ —Г—А—Ц–Ј–љ–Њ–Љ–∞–љ—Ц—В–љ—О—О—З–Є –љ–∞–±–Њ—А–Є –і–∞–љ–Є—Е, —П–Ї—Ц –≤–Є–Ї–Њ—А–Є—Б—В–Њ–≤—Г—О—В—М—Б—П –і–ї—П –љ–∞–≤—З–∞–љ–љ—П –®–Ж, —А–Њ–Ј—А–Њ–±–љ–Є–Ї–Є –Љ–Њ–ґ—Г—В—М –Ј—А–Њ–±–Є—В–Є —Б–Є—Б—В–µ–Љ–Є –®–Ж –±—Ц–ї—М—И –≤–њ—А–∞–≤–љ–Є–Љ–Є —Г –≤–Є—П–≤–ї–µ–љ–љ—Ц –і–µ–Ј—Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—Ч –≤ —А—Ц–Ј–љ–Є—Е –Љ–Њ–≤–∞—Е, –Ї—Г–ї—М—В—Г—А–∞—Е —Ц –Ї–Њ–љ—В–µ–Ї—Б—В–∞—Е.

7. –Ь–∞–є–±—Г—В–љ—Ф –®–Ж —Г –≤–Є—П–≤–ї–µ–љ–љ—Ц –і–µ–Ј—Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—Ч

–Я–Њ–Ї—А–∞—Й–µ–љ—Ц –Љ–Њ–≤–љ—Ц –Љ–Њ–і–µ–ї—Ц: —И—В—Г—З–љ–Є–є —Ц–љ—В–µ–ї–µ–Ї—В —Б—В–∞—Ф –≤—Б–µ –±—Ц–ї—М—И –≤–њ—А–∞–≤–љ–Є–Љ —Г —А–Њ–Ј—Г–Љ—Ц–љ–љ—Ц –Ї–Њ–љ—В–µ–Ї—Б—В—Г, —В–Њ–љ—Г —В–∞ –љ—О–∞–љ—Б—Ц–≤ –ї—О–і—Б—М–Ї–Њ—Ч –Љ–Њ–≤–Є. –¶–µ –Ј—А–Њ–±–Є—В—М –®–Ж –Ї—А–∞—Й–Є–Љ —Г –≤–Є–Ј–љ–∞—З–µ–љ–љ—Ц –і–µ–Ј—Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—Ч –≤ —И–Є—А–Њ–Ї–Њ–Љ—Г –і—Ц–∞–њ–∞–Ј–Њ–љ—Ц —Д–Њ—А–Љ–∞—В—Ц–≤, –≤–Ї–ї—О—З–∞—О—З–Є —Б–∞—А–Ї–∞–Ј–Љ, –≥—Г–Љ–Њ—А —Ц –љ–µ–њ—А—П–Љ—Г –±—А–µ—Е–љ—О.

–°–њ—Ц–ї—М–љ—Ц –Љ–µ—А–µ–ґ—Ц —И—В—Г—З–љ–Њ–≥–Њ —Ц–љ—В–µ–ї–µ–Ї—В—Г: —Г –Љ–∞–є–±—Г—В–љ—М–Њ–Љ—Г —Б–Є—Б—В–µ–Љ–Є —И—В—Г—З–љ–Њ–≥–Њ —Ц–љ—В–µ–ї–µ–Ї—В—Г –Ј–Љ–Њ–ґ—Г—В—М –Њ–±–Љ—Ц–љ—О–≤–∞—В–Є—Б—П —Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—Ф—О —В–∞ –љ–∞–≤—З–∞—В–Є—Б—П –Њ–і–љ–∞ –≤ –Њ–і–љ–Њ—Ч, —Б—В–≤–Њ—А—О—О—З–Є —Б–њ—Ц–ї—М–љ—Г –Љ–µ—А–µ–ґ—Г, —П–Ї–∞ –Ј–Љ–Њ–ґ–µ –µ—Д–µ–Ї—В–Є–≤–љ—Ц—И–µ –≤–Є—П–≤–ї—П—В–Є –і–µ–Ј—Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—О –љ–∞ –±–∞–≥–∞—В—М–Њ—Е –њ–ї–∞—В—Д–Њ—А–Љ–∞—Е —Ц –і–ґ–µ—А–µ–ї–∞—Е.

–Я–Њ–Ї—А–∞—Й–µ–љ–µ –≤–Є—П–≤–ї–µ–љ–љ—П –і–Є–њ—Д–µ–є–Ї—Ц–≤ —Ц —Б–Є–љ—В–µ—В–Є—З–љ–Є—Е –љ–Њ—Б—Ц—Ч–≤: –Њ—Б–Ї—Ц–ї—М–Ї–Є —В–µ—Е–љ–Њ–ї–Њ–≥—Ц—П —Б—В–≤–Њ—А–µ–љ–љ—П –і–Є–њ—Д–µ–є–Ї—Ц–≤ —Б—В–∞—Ф –≤—Б–µ –±—Ц–ї—М—И –і–Њ—Б–Ї–Њ–љ–∞–ї–Њ—О, —Ц–љ—Б—В—А—Г–Љ–µ–љ—В–Є —И—В—Г—З–љ–Њ–≥–Њ —Ц–љ—В–µ–ї–µ–Ї—В—Г –њ–Њ–Ї—А–∞—Й—Г–≤–∞—В–Є–Љ—Г—В—М —Б–≤–Њ—О –Ј–і–∞—В–љ—Ц—Б—В—М –≤–Є—П–≤–ї—П—В–Є –њ—Ц–і—А–Њ–±–ї–µ–љ—Ц –Ј–Њ–±—А–∞–ґ–µ–љ–љ—П, –≤—Ц–і–µ–Њ —В–∞ –∞—Г–і—Ц–Њ—Д–∞–є–ї–Є, —Й–Њ —Г—Б–Ї–ї–∞–і–љ–Є—В—М –љ–µ–њ–Њ–Љ—Ц—З–µ–љ–µ –њ–Њ—И–Є—А–µ–љ–љ—П —Д–µ–є–Ї–Њ–≤–Њ–≥–Њ –≤–Љ—Ц—Б—В—Г.

–†–Њ–Ј—А–Њ–±–Ї–∞ –њ–Њ–ї—Ц—В–Є–Ї–Є –љ–∞ –Њ—Б–љ–Њ–≤—Ц —И—В—Г—З–љ–Њ–≥–Њ —Ц–љ—В–µ–ї–µ–Ї—В—Г: —И—В—Г—З–љ–Є–є —Ц–љ—В–µ–ї–µ–Ї—В —В–∞–Ї–Њ–ґ –Љ–Њ–ґ–µ –Ј—Ц–≥—А–∞—В–Є –њ–µ–≤–љ—Г —А–Њ–ї—М —Г —А–Њ–Ј—А–Њ–±—Ж—Ц –Ї—А–∞—Й–Њ—Ч –њ–Њ–ї—Ц—В–Є–Ї–Є —Й–Њ–і–Њ –Њ–±—А–Њ–±–Ї–Є –і–µ–Ј—Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—Ч. –Р–љ–∞–ї—Ц–Ј—Г—О—З–Є –Ј–∞–Ї–Њ–љ–Њ–Љ—Ц—А–љ–Њ—Б—В—Ц –≤ –і–µ–Ј—Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—Ч, —И—В—Г—З–љ–Є–є —Ц–љ—В–µ–ї–µ–Ї—В –Љ–Њ–ґ–µ –і–Њ–њ–Њ–Љ–Њ–≥—В–Є –Ї–Њ–Љ–њ–∞–љ—Ц—П–Љ —Б–Њ—Ж—Ц–∞–ї—М–љ–Є—Е –Љ–µ–і—Ц–∞ —Б—В–≤–Њ—А–Є—В–Є –±—Ц–ї—М—И —Ж—Ц–ї–µ—Б–њ—А—П–Љ–Њ–≤–∞–љ—Ц —В–∞ –µ—Д–µ–Ї—В–Є–≤–љ—Ц —Б—В—А–∞—В–µ–≥—Ц—Ч –і–ї—П –Ј–∞–њ–Њ–±—Ц–≥–∞–љ–љ—П –њ–Њ—И–Є—А–µ–љ–љ—О –љ–µ–њ—А–∞–≤–і–Є–≤–Є—Е –Ј–∞—П–≤.

8. –Т–Є—Б–љ–Њ–≤–Њ–Ї: –≤–Є–Ї–Њ—А–Є—Б—В–∞–љ–љ—П –®–Ж –і–ї—П –≤—Ц–і–љ–Њ–≤–ї–µ–љ–љ—П –і–Њ–≤—Ц—А–Є –і–Њ —Б–Њ—Ж—Ц–∞–ї—М–љ–Є—Е –Љ–µ—А–µ–ґ

–•–Њ—З–∞ –њ—А–Њ–±–ї–µ–Љ–Є –Ј–∞–ї–Є—И–∞—О—В—М—Б—П, –®–Ж –њ—А–Њ–њ–Њ–љ—Г—Ф –±–∞–≥–∞—В–Њ–Њ–±—Ц—Ж—П—О—З–Є–є —Ц–љ—Б—В—А—Г–Љ–µ–љ—В —Г –±–Њ—А–Њ—В—М–±—Ц –Ј —Д–µ–є–Ї–Њ–≤–Є–Љ–Є –љ–Њ–≤–Є–љ–∞–Љ–Є —В–∞ –Њ–Љ–∞–љ–ї–Є–≤–Є–Љ –Ї–Њ–љ—В–µ–љ—В–Њ–Љ. –Ю—Б–Ї—Ц–ї—М–Ї–Є —В–µ—Е–љ–Њ–ї–Њ–≥—Ц—П —И—В—Г—З–љ–Њ–≥–Њ —Ц–љ—В–µ–ї–µ–Ї—В—Г –њ—А–Њ–і–Њ–≤–ґ—Г—Ф —А–Њ–Ј–≤–Є–≤–∞—В–Є—Б—П, –Љ–Є –Љ–Њ–ґ–µ–Љ–Њ –Њ—З—Ц–Ї—Г–≤–∞—В–Є —Й–µ –±—Ц–ї—М—И–µ —Ц–љ–љ–Њ–≤–∞—Ж—Ц–є–љ–Є—Е —Б–њ–Њ—Б–Њ–±—Ц–≤ –≥–∞—А–∞–љ—В—Г–≤–∞—В–Є, —Й–Њ —Ц–љ—Д–Њ—А–Љ–∞—Ж—Ц—П, —П–Ї—Г –Љ–Є –Њ—В—А–Є–Љ—Г—Ф–Љ–Њ –≤ –Ж–љ—В–µ—А–љ–µ—В—Ц, —Ф —В–Њ—З–љ–Њ—О, –љ–∞–і—Ц–є–љ–Њ—О —В–∞ —Ж—Ц–љ–љ–Њ—О.